Texture Diffusion v1

Add-on Blender qui utilise les normal maps du modèle 3D pour guider la génération IA et texturer l'objet entier.

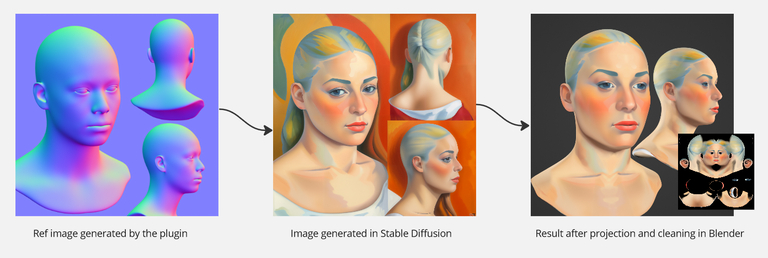

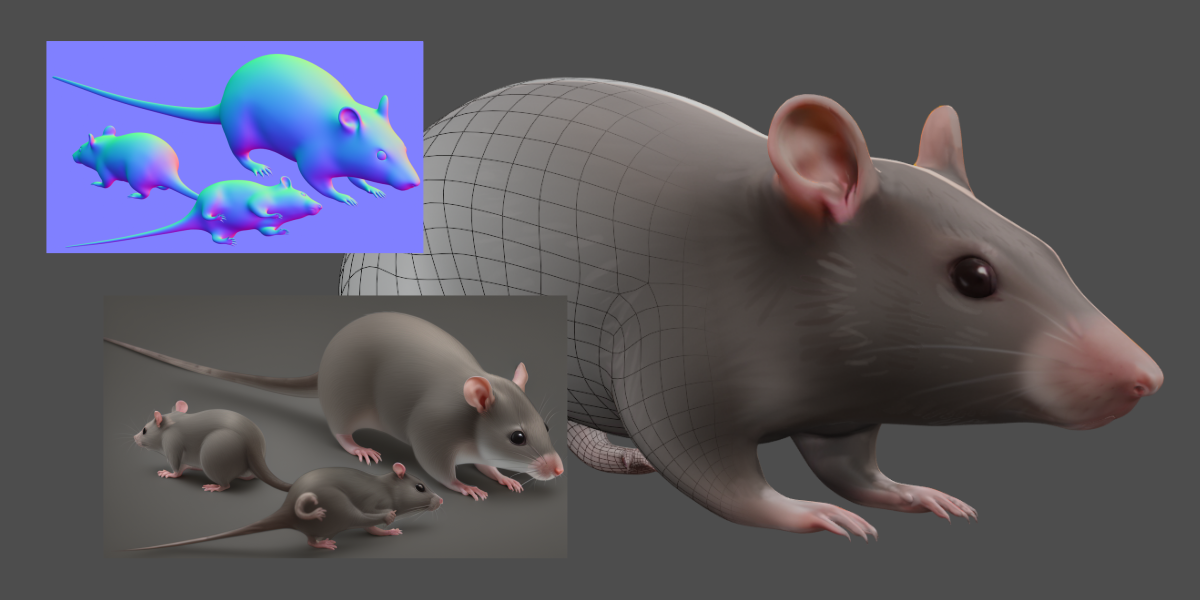

La première version de Texture Diffusion. L’idée : utiliser la géométrie 3D d’un modèle Blender pour guider Stable Diffusion et générer une texture complète de l’objet.

Le workflow repose sur les normal maps. L’add-on rend les normales du modèle sous différents angles, les envoie à ControlNet comme guide de génération, et récupère les résultats pour les remapper proprement sur le mesh. C’est la forme 3D qui contraint l’IA, pas l’inverse.

Ça a été conçu au moment où Stable Diffusion et ControlNet débarquaient. À l’époque, l’idée de laisser la géométrie guider la génération n’était pas encore répandue. L’add-on tourne avec ComfyUI ou n’importe quel backend Stable Diffusion compatible ControlNet.

Distribué sur Blender Market et Gumroad, avec 44 ventes et quasi aucun marketing.

Documentation complète — Code source — Thread Blender Artists